AI taxonomie

“Zou je het idee achter IQ ook kunnen toepassen in de Artificial wereld? Een AIQ om de maturiteit van de betreffende variant aan te geven?” Ik schreef het hier kort geleden. Toeval of niet, maar ongeveer per ommegaande werd ik op mijn wenken bediend.

Een team van DeepMind heeft op 4 november 2023 een artikel gepubliceerd met een voorstel voor “… a framework for classifying the capabilities and behavior of Artificial General Intelligence (AGI) models and their precursors...”.

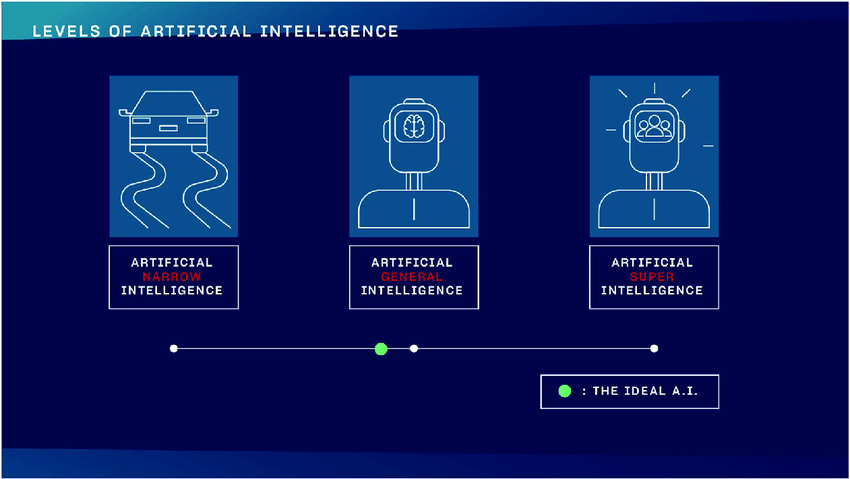

De auteurs definiëren verschillende niveaus – Levels of AGI. Ze passen die toe op zowel Narrow AI als General AI, met voorbeelden voor een inschatting van de huidige stand van zaken.

Het artikel is een voorstel voor een classificatie-raamwerk, een taxonomie. Het is rijk aan voorbeelden en casussen uit heden en verleden, en bevat een uitgebreide lijst aan referenties en bijbehorende links. Ik bespreek het hier.

Casuïstiek

Ook het team van DeepMind worstelt met definitiekwesties. Wat is AGI? In het artikel wordt een aantal case studies gepresenteerd, zoals de oorspronkelijke Turing Test (1950). Zoals het werk van John Searle waarin hij stelt dat met de juiste programmatuur computers letterlijk begrip en andere cognitieve statussen kunnen hebben (1980). Analogie met het menselijk brein door Mark Gubrud in 1997 – hij introduceerde ook de term AGI. Presteren bij cognitieve taken op menselijk niveau, met nadruk op het non-fysieke karakter van die taken (Ben Goertzel in 2014). Metacognitieve vaardigheden zoals het kunnen aanleren van nieuwe skills (2015, Shanahan). Het kunnen doen van complexe taken die meerdere stappen en vooruitdenken vragen (Suleyman in The Coming Wave, 2023). En meer casuïstiek.

Principes en uitgangspunten

Op basis van de voorbeelden en casusssen komt DeepMind met in totaal zes uitgangspunten die bijdragen aan een heldere en operationele definitie van AGI.

- Focus op bekwaamheid (capability), niet op proces.

Het gaat er om wat een AGI voor elkaar kan krijgen, niet om het mechanisme dat wordt gebruikt. Daarmee blijven we ook ver van de discussie of systemen kunnen ‘denken’ of ‘begrijpen’. - Focus op zowel algemeenheid (generality) als prestatie (performance). Prestatie is per definitie altijd narrow, specialistisch.

- Focus op zowel cognitieve als metacognitieve taken. De vraag of er bij AGI ook sprake moet zijn van een fysieke component, een robot zeg maar, laten we hier in het midden.

- Focus op potentieel, niet op realisatie of uitvoering (deployment).

- Focus op ecologische waarde – AGI die de halve aarde aan resources nodig heeft is niet waardevol.

- Focus op het pad naar AGI, niet een enkel eindpunt.

Taxonomie

Voor de classificatie willen de auteurs vijf niveaus onderscheiden, ze stellen ook naamgeving voor. Net als bij de tabellen voor menselijk IQ gangbaar is gebruiken de ze percentielen om de niveaus af te bakenen.

Ik laat de voorgestelde namen onvertaald.

- Emerging. Op dit niveau presteert de AI gelijk of iets beter dan de gemiddelde mens die niet over specifieke vaardigheden beschikt.

- Competent. Prestaties zijn minimaal in het 50e percentiel van volwassenen met relevante kennis en vaardigheden (skilled adults), niet het algemene publiek.

- Expert. Prestaties minimaal in het 90e percentiel van de skilled adults.

- Virtuoso. Prestaties minimaal in het 99e percentiel. Vergelijk: bij IQ tabellen komt het 99e percentiel overeen met een IQ van 135.

- Superhuman. Betere presentaties dan 100% van de mensheid. Bij Narrow AI wordt dit niveau al door sommige systemen gehaald, denk aan AlphaFold bij het voorspellen van de 3-dimensionale configuratie van een eiwit op basis van de lineaire sequentie van aminozuren (meestal ligt het aantal letters in een DNA-string rond de 1600).

Als het om het algemene bereik van cognitieve en metacognitieve vaardigheden gaat is dit het niveau dat we eerder als ASI, Artificial Super Intelligence hebben aangeduid.

De niveaus zijn in de afbeelding opgenomen, met twee ‘lijnen’ conform principe 2.: Narrow resp. General. Waar mogelijk is per onderdeel een aantal voorbeelden opgenomen. Voor Narrow AI is er op elk niveau nog wel iets te vinden, in de lijn General AI is er alleen bij Emerging een eerste aanzet – bij de huidige taalmodellen – bij de andere niveaus van AGI zijn nog geen voorbeelden te geven.

Wanneer is AGI ook echt AGI?

De gekozen taxonomie vergt een gedegen uitwerking van testmetingen en benchmarking. Ook dit onderwerp staat nog aan het begin van de rit, zeker als je de gekozen uitgangspunten als – streng – beoordelingskader zou willen gebruiken. Daar waar het gaat om performance geven de percentiel grenzen mogelijkheden om te ‘meten’. maar als het om de brede algemeenheid gaat zijn er vooral nog openstaande vragen.

Welke verzameling taken moet je definiëren om algemeen genoeg te zijn? En als je die taken dan hebt bepaald, welk deel met succesvolle uitvoering bepaalt dan het niveau?

Zijn er knock-out criteria – taken die in elk geval succesvol gedaan moeten worden om een bepaald AGI niveau te halen? Bijvoorbeeld meta-cognitieve taken? En zo voort.

De auteurs pleiten voor een AGI benchmark die een brede verzameling cognitieve en metacognitieve taken omvat, waaronder in elk geval taken op het gebied van taalkundige intelligentie, wiskundige en logische redeneringen, ruimtelijk inzicht, sociale intelligentie, het vermogen om nieuwe vaardigheden aan te leren en creativiteit. En als je de AI vergelijkt met de performance van een mens op dezelfde taken, mag die mens dan technologische hulpmiddelen gebruiken, waaronder AI-tools?

Het ontwikkelen van een AGI benchmark wordt een uitdagend en iteratief proces, volgens de auteurs, en een richtpunt voor de AI research gemeenschap.

Autonomie

Ook op deze site is al een aantal malen gerefereerd aan een bepaalde angst voor AGI, de vrees dat die uiteindelijk een existentieel risico voor de mensheid wordt. De niveau-gerichte benadering kan een deel van die vrees wegnemen, of er voor zorgen dat er tijdig maatregelen worden genomen. Denk bijvoorbeeld aan het zorgen voor nieuwe banen voor mensen die op de arbeidsmarkt hun baan aan AI dreigen kwijt te raken.

De feitelijke vrees dat het uit de hand gaat lopen betreft vooral de Virtuoso en Superhuman niveaus waar de AI de mens op intelligentie gaat overtreffen, niet alleen op een specifieke set taken maar in de volle breedte.

De vijf niveaus van AGI zoals in het schema bestaan natuurlijk niet in isolatie. Het gaat om taken die in context worden uitgevoerd. De context bepaalt in hoge mate de risico’s die met de AI gepaard gaan. Die zullen soms samen gaan met het taakgebied in kwestie. Op dit moment is er veel discussie over de mogelijkheid om met behulp van AI biochemische wapens te ontwerpen en te maken, of andere dreigingen voor te bereiden. Toch zitten voor mij hier niet de meest angstige scenario’s: AI doet het niet zelf, er is altijd een groep menselijke slechteriken bij nodig. Met of zonder AI is daar misschien niet veel verschil met het gewone leven.

De game changer, als je het zo wilt noemen, hangt samen met de factor ‘autonomie‘. De zelfrijdende auto is een voorbeeld dat al zo vaak is opgevoerd in de discussie dat het bijna een metafoor is geworden, inclusief geconstrueerde morele dilemma’s. Die zijn nog relatief onschadelijk in vergelijking met andere werelden, bijvoorbeeld die waarin van AI voorziene wapens zelf beslissingen nemen. Of die met robots die ingezet worden voor (fysieke) bewakingstaken. Of klimaatmodellen die niet alleen uitrekenen wat het effect van bepaalde maatregelen zoals klimaat- en geo-engineering zal zijn maar op dat terrein ook zelfstandig mogen beslissen of klaar gezette scenario’s uitgevoerd gaan worden.

Voor de auteurs van het artikel is er zo genoeg aanleiding om ook niveaus van autonomie te onderscheiden, ook vijf in getal. Autonomie is weliswaar een andere dimensie, maar niet los te zien van de niveaus van AGI. In het artikel wordt een eerste opzet gegeven waarin de niveaus van autonomie worden benoemd en tentatief gekoppeld aan mogelijke toepassingen en bijbehorend AGI niveau. Ik laat het hier bij de lijst van vijf niveaus van autonomie in relatie met AGI. De vertaling in het Nederlands is hier lastig, het gebruikte Engelse woord staat tussen haakjes. Met name voor de laatste, ‘agent’, is het moeilijk een equivalent in het Nederlands te vinden. Actor is een optie, of algoritme, of entiteit. Ik heb gekozen voor ‘zelfstandig agent’.

- Gereedschap (tool). Mensen hebben volledige controle en gebruiken AI om dagelijkse (sub) te automatiseren

- Adviseur (consultant). AI speelt een belangrijke en zelfstandige rol, maar alleen nadat mensen dit hebben gevraagd.

- Meewerker (collaborator). Gelijkwaardige samenwerking tussen mens en AI, met een interactieve coördinatie en afstemming van doelen en uitvoering.

- Expert (expert). AI heeft hier het initiatief, mensen geven begeleiding en feedback en helpen soms mee op aanwijzing van de expert.

- Zelfstandig agent (agent). De AI is hier volledig autonoom, hoeft niet aangezet of gevraagd te worden maar neemt zelf initiatieven.

Risico’s

Met het inzetten van AGI worden risico’s geïntroduceerd die er niet eerder op die manier waren. Dat is bij elke nieuwe technologie het geval. Denk aan de spreekwoordelijke man met rode vlag die vooruit moest lopen bij de eerste gemotoriseerde voertuigen. In het artikel dat we hier bespreken wordt een aantal voorbeelden van ‘nieuwe’ risico’s genoemd, maar nog niet erg uitgewerkt.